ڈس انفارمیشن کے بعد ’ڈیپ فیک‘ کا خطرہ

سماجی انتشار ، پولرائزیشن اور جمہوری عمل کمزور پڑنے کے خدشات

نور اللہ جاوید، کولکاتا

آرٹیفیشل انٹلیجنس کی وجہ سے دنیابھر میں کئی حوادث و تنازعات وقوع پذیر ۔ بروقت لگام کسنا ضروری

مرکزی حکومت کے ذریعہ ڈیپ فیک اور ڈس انفارمیشن پر قابو پانے کے لیے جو اقدامات کیے جارہے ہیں اور سوشل میڈیا کمپنیوں کو جس طریقے سے نوٹسیں جاری کی گئی ہیں اس نے انسداد اطلاعات کا خطرہ پیدا کر دیا ہے کیوں کہ حکومت اس کی آڑ میں اپنے مخالفین کی آواز کو دبانے کی کوشش کر رہی ہے۔

اس سے بڑا المیہ اور کیا ہوسکتا ہے کہ وزیر اعظم نریندر مودی نے ’’ڈیپ فیک‘‘ کے غلط استعمال اور اس کے خطرناک نتائج پر تشویش کے اظہار کے لیے صحافیوں کی اس خصوصی جماعت سے ملاقات کا انتخاب کیا جس کا فیک نیوز اور گمراہ کن معلومات کے حوالے سے اچھا ریکارڈ نہیں ہے۔ صحافیوں کی اسی جماعت نے کورونا جیسی عالمی وبا کے دوران ملک کی دوسری بڑی اکثریت کے خلاف فیک نیوز اور غلط اطلاعات پھیلانے کے جرم کا ارتکاب کیا ہے۔ اور کورونا کے پھیلاو، حکومت کے ناقص انتظامات اور لاک ڈاون کی ناکامیوں کی سارا ملبہ مسلمانوں پر ڈالنے کی نہ صرف مذموم کوشش کی بلکہ انتہائی شر انگیزاصطلاح ’کورونا جہاد‘ کو اختراع کیا اور حیرت انگیز طور پر ’’ڈس انفارمیشن‘‘ کے اس پورے دور پر مرکزی حکومت اور وزیر اعظم کا بھاری بھرکم دفتر خاموش تماشائی بنا رہا۔ صحافیوں کی اس خصوصی جماعت کا یہ رویہ کوئی نیا نہیں ہے بلکہ گزشتہ ایک دہائی میں ’’ڈس انفارمیشن‘‘ ادارہ جاتی شکل اختیار کر گیا ہے۔ مخالفین کی شبیہ کو نقصان پہنچانے اور تاریخی حقائق کو مسخ کرنے کے لیے میڈیا اور ملک کی حکم راں جماعت بی جے پی نے کوئی کسر باقی نہیں چھوڑی ہے۔تحقیق اور پختہ معلومات حاصل کرنے کے بجائے نسلِ نو میں سوشل میڈیا پر گردش کرنے والے آدھے ادھورے سچ پر یقین کرنے کی ذہنیت کی پرورش وپرداخت کی گئی ہے۔ اب جب کہ ڈس انفارمیشن اور فیک نیوز کی انتہائی بدترین شکل ’’ڈیپ فیک‘‘ اپنے تمام تر خطرات اور سماج پر بدترین اثرات کے ساتھ ہمارے سامنے ہے تو وزیر اعظم مودی بذات خود سامنے آکر اس پر اپنے خدشات کا اظہار کر رہے ہیں اور یہ پیغام دینے کی کوشش کر رہے ہیں کہ ان کی حکومت ’’ڈیپ فیک‘‘ کے خطرات سے آگاہ ہے اور اس سے نمٹنے کے لیے قانونی پہلوؤں پر غور و خوض کیا جا رہا ہے۔

اس میں کوئی شک نہیں ہے کہ جدید ٹیکنالوجی اور مواصلات کی فراہمی نے حصول علم کی راہوں کو آسان کر دیا ہے۔ علم پر اجارہ داری کا خاتمہ ہوا ہے۔ تعلیم کے شعبے کے علاوہ طب، فلم پروڈکشن، جرائم کی فارنسک جانچ اور فنکارانہ اظہار میں جدید ٹیکنالوجی نے سہولتیں اور آسانیاں پیدا کی ہیں، مگر اس کے ساتھ ہی کئی طرح کے چیلنجز اور خطرات بھی پیدا کر دیے ہیں جو انسانی زندگی کے لیے ایٹم بم سے کچھ کم سنگین نہیں ہیں۔ بے مہار نفسانی خواہشات، حکم رانی اور طاقت میں اضافے کے حیوانی جوش اور تسخیر کائنات کے جذبے نے مزید مسائل پیدا کر دیے ہیں۔ آج صورت حال یہ ہے کہ دنیا اپنے ہی پیدا کردہ مسائل کے نیچے دب گئی ہے اور اس سے نکلنے کی راہیں تلاش کر رہی ہے، قانون سازی پر غور کیا جا رہا ہے اور اتفاق رائے پیدا کرنے کی کوششیں کی جارہی ہیں۔ گزشتہ ہفتے بلیچ لے پارک میں دنیا کے پہلے آرٹیفیشل انٹیلجنس ’’اے آئی‘‘ (AI) سیفٹی سمٹ کے دوران امریکہ، چین، جاپان، برطانیہ، فرانس اور بھارت سمیت دنیا کے اٹھائیس بڑے ممالک اور یورپی یونین نے ایک اعلامیہ پر دستخط کیے جس میں اے آئی (AI) کے ممکنہ خطرات سے نمٹنے کے لیے عالمی سطح پر کارروائی کی ضرورت محسوس کی گئی۔ سائبر سیکیورٹی، بائیو ٹیکنالوجی اور ڈس انفارمیشن کے خطرات کا جائزہ لینے اور اس سے پہنچنے والے نقصانات کا اعتراف کیا گیا ہے۔ اس سے قبل امریکی صدر جو بائیڈن نے ایک ایگزیکیٹو آرڈر جاری کیا جس کا مقصد ’اے آئی‘ جیسی جدید ٹیکنالوجی کی وجہ سے لاحق ہونے والے خطرات سے تحفظ فراہم کرنا تھا۔ علاوہ ازیں اے آئی بوٹس جیسے ChatGPT اور Google Bard کا جائزہ لینے اور اس کے معیارات کی نگرانی بھی مقصود تھی۔ ایگزیکٹیو آرڈر کے ذریعہ اے آئی کمپنیوں کو ہدایت دی گئی کہ اپنی نئی مصنوعات صارفین کو دستیاب کرانے سے قبل مصنوعات کے ٹسٹ کے نتائج کو وفاقی حکومت کے ساتھ شیئر کریں۔

نئی دلّی میں G20 سربراہی اجلاس سے دو ہفتے قبل وزیر اعظم مودی نے اے آئی ٹولز کے اخلاقیات کی توسیع اور قانونی فریم ورک پر زور دیا۔ مگر سوال یہ ہے کہ کیا ٹیکنالوجی کے بہاو میں اس پر قابو پانا آسان ہوگا؟ یہ سوال اور خدشات کا اظہار اس لیے کیا جا رہا ہے کہ ڈیپ فیکٹ جیسی مذموم حرکات کا محرک ڈس انفارمیشن کے ذریعہ سیاسی، معاشی اور سماجی مفادات کا حصول ہے۔ اس معاملے میں دنیا بھر کے جمہوری ممالک اور سیاسی جماعتوں کا ریکارڈ انتہائی خراب ہے، بالخصوص بھارت کا ریکارڈ اس معاملے میں انتہائی خراب ہے۔ حکم راں جماعت اور میڈیا دونوں اس کے سب سے بڑے قصور وار ہیں۔

’’غلط معلومات‘‘ کی تشریح اور اس کی تفصیلات کا یہاں موقع نہیں ہے۔ جان بوجھ کر حقائق کو توڑ مروڑ کر پیش کرنا اور عوم کو گمراہ کرنے کے مقصد سے پھیلائی جانے والی معلومات کو ’’ڈس انفارمیشن‘‘ کہا جاتا ہے ۔ اس لعنت نے دنیا بھر میں نہ صرف انسانی حقوق اور جمہوری اصولوں کو متاثر کیا ہے بلکہ فکر کی آزادی، رازداری کے حق اور جمہوریت میں عوامی شرکت کے مواقع کو کم کرنے کا کام کیا ہے۔ نیز معاشی، سماجی اور ثقافتی حقوق کو بھی خطرے میں ڈال دیا ہے۔ ’غلط معلومات‘ آزادانہ اور منصفانہ انتخابات کے مواقع کو ختم کرنے کے ساتھ ساتھ جمہوری اداروں پر شہریوں کے اعتماد میں کمی کا باعث بنتے ہیں۔ ڈس انفارمیشن کے خلاف کارروائی کے نام پر جو اقدامات کیے جا رہے ہیں اس نے درست اطلاعات تک رسائی کا خطرہ پیدا کر دیا ہے۔ غلط معلومات جہاں انسانی حقوق اور اچھے جمہوری عمل کو نقصان پہنچاتے ہیں۔ وہیں انسدادِ اطلاعات کے اقدامات انسانی حقوق اور جمہوریت پر منفی اثرات مرتب کر سکتے ہیں۔

مرکزی حکومت کے ذریعہ ڈیپ فیک اور ڈس انفارمیشن پر قابو پانے کے لیے جو اقدامات کیے جا رہے ہیں اور سوشل میڈیا کمپنیوں کو جس طریقے سے نوٹسیں جاری کی گئی ہیں اس نے انسداد اطلاعات کا خطرہ پیدا کر دیا ہے کیوں کہ حکومت اس کی آڑ میں اپنے مخالفین کی آواز کو دبانے کی کوشش کر رہی ہے۔ ظاہر ہے کہ بدنیتی اور دہرے معیار کے ساتھ کیے جانے والے اقدامات سے کسی بھی بڑے خطرے کا مقابلہ نہیں کیا جاسکتا۔ وزیر اعظم مودی کی نیت پر شک و شبہ اگر نہ بھی کیا جائے تب بھی یہ سوالات اپنی جگہ برقرار رہیں گے کہ گزشتہ دس سالوں میں ان کی جماعت نے ’’ڈس انفارمیشن‘‘ کے ذریعہ اپنے حریف کو پست اور انتخابات میں حاوی ہونے کے جو حربے آزمائے ہیں کیا اس کا تجزیہ کرنے کی ضرورت نہیں ہے؟ بی جے پی کے ’سوشل میڈیا سیل‘ نے جہالت بالخصوص مسلم حکم رانوں اور مسلم تواریخ کے متعلق جو غلط معلومات پھیلائی ہیں اس نے پوری نئی نسل میں علم و تحقیق کے جذبے کو ختم کر دیا ہے۔ایسے میں سوال یہ ہے کہ کیا ’’ڈس انفارمیشن‘‘ کی حوصلہ شکنی کیے بغیر ’’ڈیپ فیک‘‘ کے خلاف کی جانے والی کارروائی کارآمد ثابت ہوگی؟

ڈیپ فیک اور اس کے اثرات کیا ہیں؟

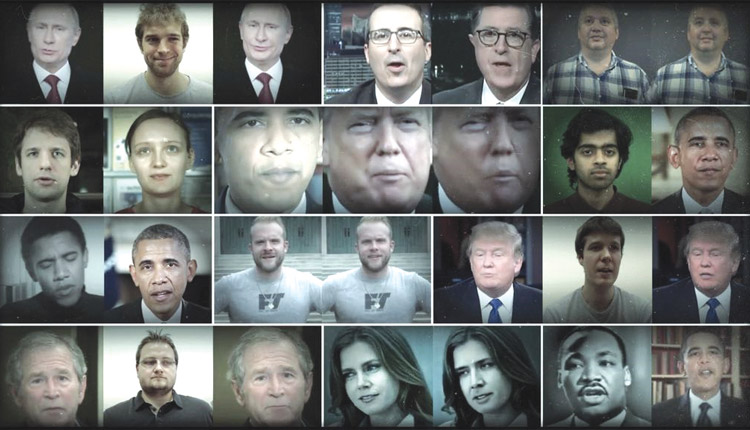

ویڈیو، آڈیو اور تصاویر میں ترمیم اور مصنوعی ذہانت کا استعمال کرتے ہوئے جوڑ توڑ کر کے حقائق کو توڑ مروڑ کرنے کو ’’ڈیپ فیک‘‘ کہتے ہیں۔ ڈیپ فیک، افراد اور اداروں کو نقصان پہنچانے کے لیے بنائے جاتے ہیں۔ کموڈیٹی کلاؤڈ کمپیوٹنگ تک رسائی، عوامی تحقیق اے آئی الگورتھم اور وافر ڈیٹا اور وسیع میڈیا کی دستیابی نے میڈیا کی تخلیق اور ہیرا پھیری کو جمہوری بنانے کے لیے ایک بدترین طوفان کھڑا کر دیا ہے۔ اس مصنوعی میڈیا مواد کو ڈیپ فیک کہا جاتا ہے۔ تاہم جیسے جیسے مصنوعی میڈیا ٹیکنالوجی تک رسائی بڑھتی جارہی ہے، اسی طرح استحصال کا خطرہ بھی بڑھ رہا ہے ہے۔ ’ڈیپ فیک‘ کا استعمال ساکھ کو نقصان پہنچانے، ثبوت گھڑنے، عوام کو دھوکہ دینے اور جمہوری اداروں پر اعتماد کو کمزور کرنے کے لیے استعمال کیا جاتا ہے۔ یہ سب کچھ کم وسائل کے ساتھ، پیمانے اور رفتار کے ساتھ حاصل کیا جا سکتا ہے۔

ڈیپ فیک کے اثرات بالخصوص پولرائزنگ دنیا اور منقسم آن لائن ایکو سسٹم میں خطرناک ثابت ہو رہے ہیں۔ دنیا بھر میں اس پر تشویش پائی جارہی ہے۔ میٹا (فیس بک، انسٹا گرام، واٹس اپ) اور گوگل سمیت بڑی آئی ٹی کمپنیوں نے ’ڈیپ فیک‘ سے نمٹنے کے لیے ٹکنالوجی کی ایجاد اور دیگر اقدامات کا اعلان کیا ہے مگر ان کے نظام میں اتنی دراڑیں ہیں کہ اس کا فائدہ غلط معلومات پھیلانے والے آسانی سے کرلیتے ہیں۔ مقبول اداکاروں کے ڈیپ فیک کے ساتھ پوری فحش سائٹس سامنے آچکی ہیں۔ اس ٹیکنالوجی نے انتخابی سالمیت کے بارے میں بھی خدشات کو جنم دیا ہے۔ ماہرین کا خیال ہے کہ ’آئی اے‘ جیسی جدید ٹیکنالوجی کی مدد سے پورے انتخابی عمل کو متاثر کیا جا سکتا ہے۔ سیاست دانوں کی آڈیو یا ویڈیو میں ہیرا پھیری کرکے کسی بھی سیاسی شخصیت کے کردار کو مجروح کیا جاسکتا ہے۔ امریکہ اور بھارت میں اگلے سال ہونے والے انتخابات سے متعلق خدشات کا اظہار کیا جارہا ہے کہ ’’اے آئی‘‘ جیسی جدید ٹیکنالوجی کی مدد سے پورے انتخابی عمل کو متاثر کیا جاسکتا ہے۔ رائے عامہ پر اثر انداز ہونے کے لیے سیاسی جماعتوں اور سیاسی لیڈروں کی تصاویر اور ان کی آواز کو ’اے آئی‘ کی مدد سے تبدیل کیا جا سکتا ہے۔ چند مہینے قبل تمل ناڈو کے وزیر خزانہ پالانیول تھیاگا راجن کے ایک سے زائد آڈیو کلپ سامنے آئے تھے جس میں وہ اپنی ہی حکومت اور وزیر اعلیٰ اسٹالن کے بیٹے اور داماد پر سنگین الزامات عائد کرتے ہوئے نظر آرہے ہیں۔ اسٹالن کے بیٹے ادھیاندھی اسٹالن اور داماد وی سبریسن پر ایک سال میں تیس ہزار کروڑ روپے کی ناجائز دولت جمع کرنے کا الزام لگاتے ہوئے سنا گیا ہے۔ انہوں نے دعویٰ کیا کہ ’’اے آئی‘‘ کی مدد سے ان کی آواز کے ساتھ ہیرا پھیری کی گئی ہے۔ حالیہ اسمبلی انتخابات میں بھی سیاسی جماعتیں ایک دوسرے پر اے آئی کی جدید ٹیکنالوجی کے غلط استعمال کرنے کا استعمال الزام عائد کر رہی ہیں۔ اس سے قبل دلی اسمبلی انتخابات کے دوران بی جے پی کے ریاستی صدر منوج تیواری نے خود اپنی ڈیپ فیک ویڈیو تیار کی جس میں وہ انگریزی اور ہریانوی لہجے میں ووٹ کے لیے اپیل کررہے ہیں اور بی جے پی کے پچاس ہزار سے زائد واٹس ایپ گروپوں میں اس کو شیئر کیا گیا تھا۔ کہا جاتا ہے کہ بھارت کی سیاست میں ڈیپ فیک کے استعمال کی یہ پہلی مثال تھی۔ بین الاقوامی سطح پر حالیہ برسوں میں ڈیپ فیک کی بدترین شکلیں ہماری سامنے آئی ہیں۔ 2019 میں مرکزی افریقہ کے ملک ’’گبون‘‘ کے صدر علی بونگو کی ڈیپ فیک ویڈیو کے ذریعہ یہ ثابت کرنے کی کوشش کی گئی وہ ملک کی حکم رانی کے لیے جسمانی طور پر فٹ نہیں ہیں۔ اس ویڈیو کے ذریعہ گبون کے افواج کو بغاوت پر آمادہ کیا گیا۔ اس سال کے شروع میں مئی میں واشنگٹن ڈی سی میں امریکہ کے محکمہ دفاع کے ہیڈکوارٹر پینٹاگون کے قریب دھماکے کی ایک جعلی تصویر سوشل میڈیا اکاؤنٹس پر بڑے پیمانے پر شیئر کی گئی، اسے کچھ تصدیق شدہ اکاؤنٹس کے ذریعہ بھی شیئر کیا گیا۔ اس ویڈیو کو بھارت کی مین اسٹریم ٹی وی نیوز چینلوں نے بھی نشر کیا۔ بعد میں یہ انکشاف ہوا کہ یہ تصویر ممکنہ طور پر جنریٹیو آرٹیفیشل انٹیلیجنس (AI) کے ذریعے بنائی گئی ہے۔ روس یوکرین تنازع اور جاری جنگ مصنوعی ذہانت (AI) کے تجربات کا مرکز بن گئی ہے۔ بھارت کا ایک مشہور ہندی نیوز چینل جو جنگوں کی جعلی رپورٹنگ کے لیے کافی مشہور ہے، اس نے AI کے ذریعہ روس کی کارروائی کے چند ہفتے بعد ہی دعویٰ کر دیا تھا کہ روسی افواج نے یوکرین پر قبضہ کر لیا ہے۔ مارچ 2022 میں یوکرین کے صدر ولادیمیر زیلنسکی کی اپنی فوجیوں سے ہتھیار ڈالنے کی ہدایت دیتے ہوئے ایک ویڈیو وائرل ہوئی تھی۔ بعد میں معلوم ہوا کہ یہ ویڈیو جعلی تھا۔ تاہم ویڈیو کی بناوٹ کی سطح بہت زیادہ معیاری نہیں تھی، جس کی وجہ سے اسے جعلی سمجھنا آسان ہو گیا۔ اسی طرح روسی صدر ولادیمیر پوتن کی ایک جعلی ویڈیو جس میں وہ اپنے فوجیوں کو ہتھیار ڈالنے اور گھر جانے کی تلقین کر تے ہوئے نظر آرہے ہیں ٹوئٹر پر وائرل ہوئی۔ گراونڈ رپورٹنگ سے عاری میڈیا کوریج نے اس طرح کے جعلی ویڈیوز کے پھیلاو کے امکانات کو بڑھا دیا ہے۔

’’ڈیپ فیک‘‘ کے سیاسی اثرات کے تعلق سے کافی باتیں ہو رہی ہیں مگر اس کی وجہ سے جو سماجی زندگی بالخصوص خواتین کے رازداری کے حق کو جو نقصان پہنچ رہا ہے اور اس کے معاشرہ پر جو منفی اثرات مرتب ہو سکتے ہیں اس پر بہت ہی کم بات ہو رہی ہے جب کہ ڈیپ فیک کے منفی اثرات سب سے زیاد ہ معاشرے پر مرتب ہو رہے ہیں۔

سینسٹی نامی کمپنی کی رپورٹ کے مطابق ستمبر 2019تک آن لائن ڈیپ فیک ویڈیوز میں سے 96فیصد فحش تھیں، جن کو بنیادی طور پر ’’ریوینج پورن‘‘ کے زمرے میں رکھا گیا تھا۔ یہ مسئلہ واضح طور پر صنفی ہے کیونکہ ان میں سے تقریباً سبھی خواتین کی غیر مصدقہ ویڈیوز تھیں، جن میں ایما واٹسن اور اسکارلیٹ جانسن جیسی عوامی شخصیات شامل تھیں۔ ’دی اسٹیٹ آف ڈیپ فیک 2020‘ کے عنوان سے رپورٹ کا اگلا ایڈیشن اشارہ کرتا ہے کہ صرف دسمبر 2020 تک 85 ہزار سے زائد فحش ویڈیوز شیئر کیے گئے ہیں۔جنسی ڈیپ فیک یا مصنوعی جنسی مواد کا غلط استعمال صرف شہوانیت کی تسکین تک محدود نہیں ہے بلکہ اس کا استعمال افراد کو ہراساں کرنے اور بلیک میل کرنے کے لیے بھی کیا جاتا ہے۔ یہ خاص طور پر بھارت جیسے ملک میں تشویشناک ہے، جہاں فحش نگاری کی قانونی حیثیت فی الحال مبہم ہے، اس کی وجہ سے ’ریوینج پورن‘ جیسے اہم مسائل زیادہ تر غیر رپورٹ شدہ اور حل طلب ہیں۔ sensity.ai کے مطابق 96 فیصد ڈیپ فیک فحش ویڈیوز ہیں صرف فحش ویب سائٹس پر 135 ملین سے زیادہ آراءہیں۔ ڈیپ فیک پورنوگرافی خاص طور پر خواتین کو نشانہ بناتی ہے۔ فحش ڈیپ فیک دھمکیاں دے سکتے ہیں، ڈرا سکتے ہیں اور نفسیاتی نقصان پہنچا سکتے ہیں۔ خواتین کو نشانہ بنانے کے علاوہ بعض صورتوں میں، مالی نقصان اور ملازمت کے نقصان جیسے ضمنی نتائج کا باعث بھی بنتے ہیں۔ حقائق کی جانچ کرنے والے پلیٹ فارم بوم لائیو کے ڈپٹی ایڈیٹر کیرن ریبیلو بھارت میں ڈیپ فیک کے خطرات کے حوالے سے کہتے ہیں کہ باقی دنیا میں جو کچھ ہوتا ہے وہی بھارت میں بھی رونما ہوتا ہے۔ اس وقت ہم بھارت میں جو ٹکنالوجی دیکھ رہے ہیں وہ Midjourney AI جیسی ٹکنالوجیز کی بدولت ہے مگر جس طرح ٹکنالوجی میں بہتری آرہی ہے اس سے اس طرح کے جعلی آڈیو کی شناخت مشکل ہو جائے گی۔ ہم ابھی جو ڈیپ فیک دیکھ رہے ہیں ان کی شناخت کی جاسکتی ہے کیونکہ ان میں ایسی بے ضابطگیاں ہیں جنہیں کھلی آنکھوں سے دیکھا جا سکتا ہے۔ لہذا ڈیپ فیک کی شناخت کے بارے میں تکنیکی حصہ ابھی مشکل نہیں ہے۔ لیکن ٹیکنالوجی کے بہتر ہونے کے ساتھ، آپ اس مرحلے پر پہنچ جائیں گے جہاں یہ بے ضابطگیاں موجود نہیں ہوں گی۔ ریبیلو نے کہا کہ اس لیے عوامی بیداری اس طرح کی غلط معلومات کو انتخابی سیاست پر اثر انداز ہونے سے روکنے میں کلیدی حیثیت رکھتی ہیں۔ ڈیپ فیک کا پتہ لگانا صرف عوام پر نہیں چھوڑا جانا چاہیے، لیکن لوگوں پر زور دیا جانا چاہیے کہ وہ بنیادی حقائق کی جانچ کریں جیسا کہ انہیں غلط معلومات کی دیگر اقسام کے ساتھ کرنا چاہیے۔

جہاں تک قانون سازی کا سوال ہے تو ملک میں کچھ ایسے قوانین موجود ہیں جن کے منصفانہ نفاذ سے اس پر قابو پایا جاسکتا تھا۔انفارمیشن ٹکنالوجی ایکٹ 2000 کے سیکشنز، کسی بھی شخص کی رضامندی کے بغیر ان کی مباشرت کی تصاویر کی اشاعت اور ترسیل کو جرم قرار دیا گیا ہے۔ کاپی رائٹ ایکٹ 1957 کی دفعات، منصفانہ لین دین اور سالمیت کے حق کے نظریے سے متعلق ہیں۔ مزید برآں، ڈیپ فیک آئین کے آرٹیکل 21 کے تحت رازداری کے بنیادی حق کی براہ راست خلاف ورزی کرتے ہیں۔ اگر ان قوانین کو مؤثر طریقے سے نافذ کیا جاتا ہے تو نئے ڈیجیٹل پرسنل ڈیٹا پروٹیکشن بل کی خاص ضرورت نہیں ہوگی کیوں کہ اس بل کے ذریعہ اطلاعات کو روکنے اور سوشل میڈیا پر لگام کسنے کی کوشش کی گئی ہے۔

ڈیپ فیک کی تخلیق اور تقسیم روکنے کے لیے ٹیکنالوجی کی صنعت، سول سوسائٹی، اور پالیسی سازوں کے ساتھ بامقصد گفت و شنید کے ساتھ بامعنی ضابطوں کی بھی ضرورت ہے۔ سوشل میڈیا پلیٹ فارم ڈیپ فیک کے مسئلے کا نوٹس لے رہے ہیں اور تقریباً سبھی کے پاس ڈیپ فیک کے لیے کچھ پالیسی یا قابل قبول شرائط ہیں۔ ہمیں ڈیپ فیک کا پتہ لگانے، میڈیا کی توثیق کرنے اور مستند ذرائع کو وسعت دینے کے لیے استعمال میں آسان اور قابل رسائی ٹیکنالوجی کی بھی ضرورت ہے۔ ڈیپ فیک کی لعنت کا مقابلہ کرنے کے لیے، ہم سب کو انٹرنیٹ پر میڈیا کے ناقد صارفین بننے کی ذمہ داری قبول کرنی چاہیے، سوشل میڈیا پر شئیر کرنے سے پہلے سوچیں اور توقف کریں اور ’انفوڈیمک‘ (غلط معلومات کی بھرمار) کے مسئلہ کا حل برآمد کرنے کا حصہ بنیں۔ اس معاملے میں قرآن اور سیرت نبویؐ کی تعلیمات ہماری رہنمائی کرتی ہیں جن میں واضح لفظوں میں کہا گیا ہے جھوٹ پھیلانے سے اور تصدیق کے بغیر باتیں پھیلانے سے گریز کیا جائے۔

***

***

سینسٹی نامی کمپنی کی رپورٹ کے مطابق ستمبر 2019 تک آن لائن ڈیپ فیک ویڈیوز میں سے 96 فیصد فحش تھیں، جن کو بنیادی طور پر ’’ریوینج پورن‘‘ کے زمرے میں رکھا گیا تھا۔ یہ مسئلہ واضح طور پر صنفی ہے کیونکہ ان میں سے تقریباً سبھی خواتین کی غیر مصدقہ ویڈیوز تھیں، جن میں ایما واٹسن اور اسکارلیٹ جانسن جیسی عوامی شخصیات شامل تھیں۔

ہفت روزہ دعوت – شمارہ 26 نومبر تا 2 دسمبر 2023